කෘත්රිම බුද්ධියේ (AI) "ගෝඩ් ෆාදර්" කෙනෙකු, එය පරිණාමය වන වේගය ඔහු අවබෝධකර ගත්තේ නම් එහි ප්රයෝජනයට වඩා ආරක්ෂාවට ප්රමුඛත්වය දෙන බව පවසා ඇත.

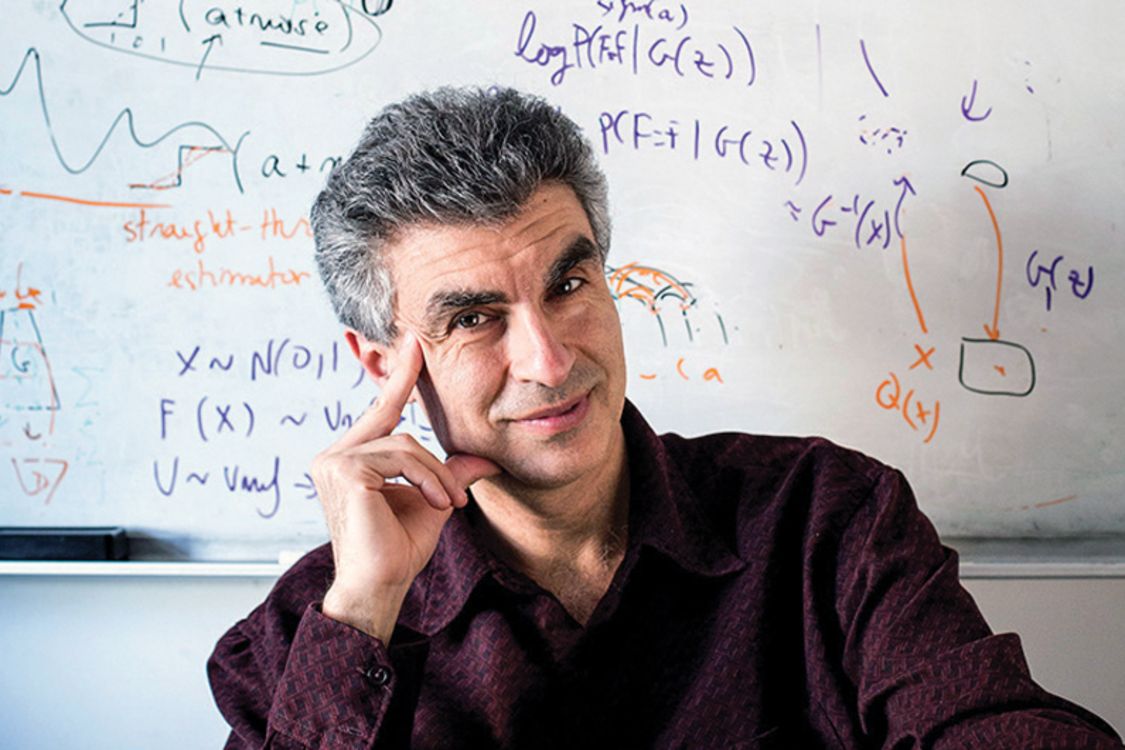

ඔහු ජීවිත කාලයක් පුරා සිදුකළ වැඩ ගැන "මංමුලා වූ" හැඟීමක් දැනෙන බව මහාචාර්ය යොෂුවා බෙන්ජියෝ බීබීසීයට පැවසුවේ ය.

පරිගණක විද්යාඥයා එම ප්රකාශය නිකුත් කළේ, කෘත්රිම බුද්ධිය පිළිබඳ විශේෂඥයින් එය මනුෂ්යත්වය වඳවී යාමට හේතු විය හැකි බව පැවසීමෙන් අනතුරුව ය.

කෘත්රිම බුද්ධිය නියාමනය සඳහා වූ ඉල්ලීම්වලට ද සම්බන්ධවී ඇති මහාචාර්ය බෙන්ජියෝ, හමුදාවන්ට AI බලතල ලබා දිය යුතුයැ යි ඔහු නොසිතූ බව පැවසුවේ ය.

කෘත්රිම බුද්ධිය සොයා ගැනීම සඳහා පුරෝගාමී වූ ද, එහි "ගෝඩ් ෆාදර්" ලෙස විරුදාවලිය ලත් තිදෙනාගෙන් දෙවැන්නා වූ ද ඔහු, එය වර්ධනය වන වේගය සහ දිශාව පිළිබඳව කනස්සල්ල පළ කර සිටියි.

පරිගණකයකට අති සංකීර්ණ කාර්යයන් ඉටු කිරීමට ඇති හැකියාව කෘත්රිම බුද්ධිය විසින් විස්තර කෙරෙන අතර, මේ කටයුතුවලට මින් පෙර මානව බුද්ධිය අවශ්ය වී තිබුණි.

මීට මෑතකාලීන උදාහරණයක් නම්, ප්රශ්නවලට මිනිසුන්ට සමාන ප්රතිචාර ලබා දෙන බව පෙනෙන, ChatGPT වැනි කෘත්රිම බුද්ධියෙන් බලගැන්වුණු චැට්බොට් සංවර්ධනය කිරීම යි.

මෙය යුරෝපා සංගමය තුළ කෘත්රිම බුද්ධිය පිළිබඳ සැලසුම්ගත නීති සම්පාදනයට හේතුවී ඇත. මැයි මාසයේ දී, බ්ලොක්හි තාක්ෂණ ප්රධානී මාග්රෙත් වෙස්ටේජර් පැවසුවේ කෘත්රිම බුද්ධිය සඳහා ස්වේච්ඡා ආචාර ධර්ම පද්ධතියක් "ඉදිරි සති කිහිපය තුළ" නිර්මාණය කළ හැකි බව ය.

"නරක පුද්ගලයන්"

මාරාන්තික නව රසායනික අවි නිපදවීම වැනි හානිකර අරමුණු සඳහා උසස් පරිගණක හැකියාව භාවිතා කළ හැකිවෙතැ යි යන්න පිළිබඳව ඇතැමුන් බිය පළ කරයි.

මහාචාර්ය බෙන්ජියෝ බීබීසී වෙත පැවසුවේ "නරක පුද්ගලයන්" කෘත්රිම බුද්ධිය ඔවුන් සතුකර ගැනීම සම්බන්ධයෙන් (විශේෂයෙන් එය වඩාත් සංකීර්ණ හා බලවත් වන විට) ඔහු කනස්සල්ලට පත්වන බව ය.

"ඒක හමුදාව වෙන්න පුළුවන්, ත්රස්තවාදීන් වෙන්න පුළුවන්, ඉතා කෝපයට පත් වූ, මනෝ ව්යාධිකයෙක් වෙන්න පුළුවන්. ඉතින් ඉතාම නරක දෙයක් කරන්න ඉල්ලන්න මේ කෘත්රිම බුද්ධි පද්ධති වැඩසටහන්ගත කරන එක පහසු නම්, ඒක ඉතා භයානක වෙන්න පුළුවන්."

"ඔවුන් අපට වඩා දක්ෂ නම්, අපට මේ පද්ධති නැවැත්වීම හෝ හානිය වළක්වා ගැනීම දුෂ්කර යි," ඔහු සඳහන් කළේ ය.

ඔහුට මඟපෙන්වීම සහ අනන්යතාවය පිළිබඳ හැඟීමක් ලබාදුන්, ඔහු ජීවිත කාලය පුරාම සිදුකළ වැඩ කටයුතු ඔහුට තවදුරටත් පැහැදිලි නොවන බැවින්, ඒවායින් ඔහුට පුද්ගලිකව හානියක් සිදුවන බව මහාචාර්ය බෙන්ජියෝ පවසයි.

"කෘත්රිම බුද්ධි ක්ෂේත්රය තුළ සිටින පුද්ගලයින්ට හැඟීම් වශයෙන් ගත්තම මේක අභියෝගාත්මක යි, " ඔහු පැවසීය.

"ඔයාට කියන්න පුළුවන් මට මංමුලා වෙලා වගෙ දැනෙනවා කියලා. නමුත් ඔබ දිගටම වැඩ කරගෙන යන්න, සාකච්ඡා කරන්න, සම්බන්ධ වෙන්න, ඔබ එක්ක හිතන්න අන් අයවත් දිරිමත් කරන්න සිද්ධවෙනවා."

මේ කැනේඩියානු ජාතිකයා විසින් කෘත්රිම බුද්ධියෙහි අනාගත අවදානම්වලින් ප්රවේශම් වන ලෙස ඉල්ලමින් ප්රකාශ දෙකකට අත්සන් කර ඇත. ඇතැම් විද්වතුන් සහ කර්මාන්තයේ ප්රවීණයන් අනතුරු අඟවා ඇත්තේ, සංවර්ධනයේ වේගය හේතුවෙන් "නරක පුද්ගලයින්" විසින් ද්වේෂසහගත අයුරින් කෘත්රිම බුද්ධිය සක්රීයව හානියක් කිරීමට - හෝ එය විසින්ම හානියක් සිදුකිරීමට තෝරා ගැනීමට ඉඩ ඇති බවයි.

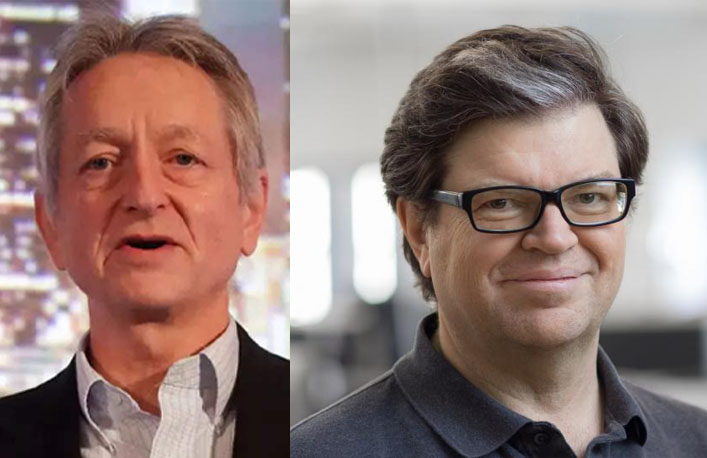

තවත් "ගොඩ් ෆාදර්" කෙනෙක් වන ආචාර්ය ජෙෆ්රි හින්ටන් ද මහාචාර්ය බෙන්ජියෝ මෙන්ම අනතුරු ඇඟවීම්වලට අත්සන් තබා ඇති අතර, ඔහු ඔහුගේ කාර්යය ගැන කනගාටු වන බව පවසමින් මාස ගණනකට පෙර ගූගල් වෙතින් විශ්රාම ගියේ ය.

ආචාර්ය ජෙෆ්රි හින්ටන් - මහාචාර්ය යාන් ලෙකූන්

ආචාර්ය ජෙෆ්රි හින්ටන් - මහාචාර්ය යාන් ලෙකූන්

මහාචාර්ය බෙන්ජියෝ සහ ආචාර්ය හින්ටන් සමග එක්ව ඔවුන්ගේ පුරෝගාමී වැඩ කටයුතු සඳහා කීර්තිමත් ටියුරින් සම්මානයක් දිනාගත් තුන්වන "ගොඩ් ෆාදර්", මහාචාර්ය යාන් ලෙකූන්, අනතුරු ඇඟවීම් අනාවැකි බහුල ලෙස ප්රකාශ කර ඇත.

ට්විටර් සහ ටෙස්ලා සමාගම්හි හිමිකරු වන එලොන් මස්ක් ද මේ සම්බන්ධයෙන් සිය කනස්සල්ල පළ කර ඇත.

"කෘත්රිම බුද්ධිය විසින් මානව වර්ගයා විනාශ කිරීමට උත්සාහ කරයි කියලා මම හිතන්නේ නැහැ. නමුත් එය අපිව දැඩි පාලනයකට යටත් කිරිමට ඉඩ තිබෙනවා," ඔහු මාස කීපයකට පෙර වෝල් ස්ට්රීට් ජර්නල් සඟරාව විසින් පවත්වන ලද උත්සවයක දී පැවසීය.

"ඒක මනුෂ්යත්වය විනාශ කිරීමේ කුඩා සම්භාවිතාවක් තිබෙනවා. ඒ අවදානම බිංදුවට කිට්ටු නමුත් නොවිය හැක්කක් නෙවෙයි."

ප්රබල කෘත්රිම බුද්ධි නිෂ්පාදන ගොඩනඟන සියලුම සමාගම් ලියාපදිංචි කළ යුතු බව මහාචාර්ය බෙන්ජියෝ බීබීසීයට පැවසීය.

"රජයන් ඔවුන් කරන්නේ මොනවාදැ යි සොයා බලන්න ඕන, ඒවා විගණනය කිරීමට ඔවුන්ට හැකිවෙන්න ඕන, මොකද ගුවන් යානා, මෝටර් රථ හෝ ඖෂධ නිෂ්පාදනය වැනි වෙනත් ඕනෑම අංශයක් සඳහා අපි කරන අවම මට්ටමේ දේ ඒක," ඔහු පැවසීය.

"මේ පද්ධතිවලට සමීපව වැඩ කරන පුද්ගලයින්ට යම් ආකාරයක සහතිකකරණයක් ලබාදෙන්නත් අවශ්ය යි. මේ සම්බන්ධයෙන් සදාචාරාත්මක පුහුණුවක් අවශ්යයි. සාමාන්යයෙන් පරිගණක විද්යාඥයින්ට එහෙම එකක් ලැබෙන්නෙ නැහැ."

නමුත් ක්ෂේත්රයේ සිටින සෑම කෙනෙකුම කෘත්රිම බුද්ධිය මිනිසුන්ගේ විනාශය වනු ඇතැ යි විශ්වාස නොකරයි - තවත් අය තර්ක කරන්නේ ආමන්ත්රණය කිරීමට අවශ්ය තවත් ඕනෑ තරම් ගැටලු ඇති බවයි.

සමාජය විසින් කෘත්රිම බුද්ධියෙහි පක්ෂග්රාහීත්වය, අපරාධ ක්රියාකාරකම් හඳුනා ගැනීම සඳහා විශ්ලේෂණ ශිල්පීය ක්රම භාවිතා කිරීම සහ චැට්බොට්වලින් වැරදි තොරතුරු පැතිරීම වැනි ගැටළු කෙරෙහි සමාජය අවධානය යොමු කළ යුතු බව ද කෘත්රිම බුද්ධි සමාගමක් වන හගින්ග්ෆේස්හි පර්යේෂණ විද්යාඥ ආචාර්ය සාෂා ලුසියෝනි පැවසුවා ය.

ආචාර්ය සාෂා ලුසියෝනි

"කෘත්රිම බුද්ධිය විසින් මනුෂ්යත්වය විනාශ කරයි කියන උපකල්පිත අවදානමට වඩා අපි ඒ ගැන අවධානය යොමු කළ යුතුයි," ඇය වැඩිදුරටත් පැවසුවා ය.

කෘත්රිම බුද්ධිය සමාජයට ප්රතිලාභ ගෙන දෙන බවට දැනටමත් බොහෝ උදාහරණ තිබේ. මාස කීපයකට පෙර කෘත්රිම බුද්ධි මෙවලමක් නව ප්රතිජීවකයක් සොයා ගත් අතර, අංශභාග රෝගියෙකුට සිතීම මඟින් පමණක් නැවත ඇවිදීමට හැකි වූයේ කෘත්රිම බුද්ධිය භාවිතයෙන් නිපදවන ලද මයික්රොචිපයකට ස්තුති වන්නට ය.

නමුත් මෙය රටවල්වල ආර්ථිකයන් මත කෘත්රිම බුද්ධියෙහි දුරදිග යන බලපෑම පිළිබඳ වන බිය සමග සමපාත වේ. සමාගම් දැනටමත් කෘත්රිම බුද්ධි මෙවලම්වලින් මිනිස් කාර්ය මණ්ඩලය ප්රතිස්ථාපනය කරමින් සිටින අතර එය හොලිවුඩයේ පිටපත් රචකයින් විසින් ක්රියාත්මක කළ වැඩ වර්ජනයට ද එක් හේතුවක් විය.

"දියුණු කිරීම්වලට කවදාවත් ප්රමාද වැඩිවෙන්නේ නැහැ. ඒක හරියටම දේශගුණික විපර්යාස හා සමාන යි," කෘත්රිම බුද්ධියෙහි වත්මන් තත්ත්වය පිළිබඳ මහාචාර්ය බෙන්ජියෝ පවසයි.

"අපි වායුගෝලයට කාබන් විශාල ප්රමාණයක් මුදා හැරලා තියෙනවා. අපි එසේ නොකළා නම් වඩා හොඳයි, නමුත් දැන් අපට කළ හැකි දේ බලමු."

(BBC සිංහල සේවය)